テキスト

みらい翻訳はAI開発をコアとして自動翻訳の社会実装を志す企業として、みなさんの関心の高いAIの世界動向を日本語で随時ご紹介します。2024年5月、EU(ヨーロッパ連合)にて、AIを規制する世界初の法案「AI規制法」が成立しました。本規制は、個々のAIシステムが社会や人々にもたらすリスクの重みに応じて、そのプロバイダーとユーザーの義務を定めています。EUにおけるAIの開発と利用を規制することで、以下の目的を達成することを目指しています。

- AIシステムの安全性、透明性、追跡可能性を確保すること

- 差別を防止し、環境に配慮したAI開発を促進すること

- イノベーションを支援しつつ、AIがもたらすリスクを管理すること

今回のAI規制法による包括的なアプローチにより、AI分野におけるEUのリーダーシップを強化し、グローバルな基準設定に影響を与えることが予想されています。

以下は欧州議会(European Parliament)がAI規制法について解説した「EU AI Act: first regulation on artificial intelligence(EU AI法:人工知能に関する初の規制)」(2023年8月6日発表・2024年6月18日最終更新)の和訳文です。

目次

EU AI規制法:人工知能に関する初の規制

EUにおける人工知能の利用は、AIを対象とした世界初の包括的な法律である「AI規制法」によって規制されます。どのように人々が保護されるのかを確認してみましょう。

EUはデジタル戦略の一環として、人工知能(AI)を規制することで、革新的な技術の開発・利用のための、より良い条件を確保しようと考えています。AIは、より良い医療、より安全でクリーンな交通、より効率的な製造、より安価で持続可能なエネルギーなど、多くの利点を生み出すことができます。

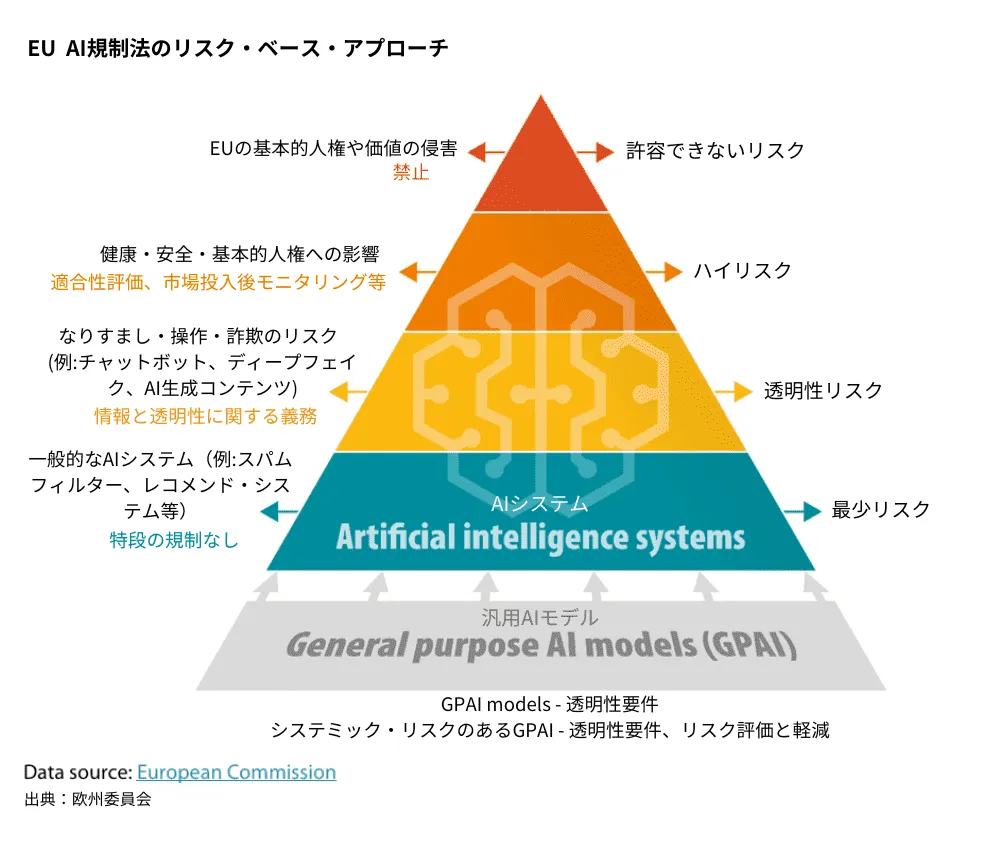

2021年4月、欧州委員会(*1)はAIに関するEU初の規制枠組みを提案しました。この規制では、さまざまな用途で使用できるAIシステムをユーザーにもたらすリスクに応じて分析・分類されます。異なるリスクレベルは、多かれ少なかれ規制があることを意味します。

(*1)欧州委員会とは、欧州連合(EU)の行政執行機関です。主な役割には、EUの政策立案、法案の提出、EU法の執行、そして国際協定の交渉などがあります。27人の委員(各加盟国から1名)で構成され、各委員は特定の政策分野を担当します。議会がAI規制法に求めるもの

議会の優先事項は、EUで使用されるAIシステムが安全で、透明性があり、追跡可能で、差別的でなく、環境に優しいものであるということを確認することにあります。AIシステムは、有害な結果を防ぐために、自動化ではなく人間によって監視されるべきです。

また、議会は将来のAIシステムに適用できるように、技術的に中立な立場で、AIの統一的な定義を確立したいと考えています。

AI規制法:リスクレベルに応じて異なる規制

この新しい規制は、人工知能のリスクレベルに応じてプロバイダーとユーザーに対する義務を定めています。多くのAIシステムは最小限のリスクしかもたらしませんが、それらを評価する必要があります。

*画像は欧州議会発表の別の文書(PDF)より引用・翻訳

*画像は欧州議会発表の別の文書(PDF)より引用・翻訳

許容できないリスク

許容できないAIシステムのリスクは、人々に対する脅威と見なされ、禁止されます。以下が該当します。

- 人々または特定の脆弱なグループの認知行動操作:子どもの危険な行動を助長する音声作動式の玩具

- ソーシャルスコアリング:行動、社会経済的地位、個人的特徴に基づいて人々を分類すること

- 生体認証による個人の識別と分類

- 顔認識などのリアルタイムおよびリモート生体認証システム

法執行の目的では、一部の例外が認められる可能性があります。「リアルタイム」のリモート生体認証システムは、限られた数の重大な事件で許可されます。一方、「事後」のリモート生体認証システムは、重大な犯罪を起訴することを目的に、大幅な遅延の後に識別が行われる状況において、裁判所の承認を得た場合にのみ許可されます。

ハイリスク

安全や基本的人権に悪影響を及ぼすAIシステムはハイリスクとみなされ、2つのカテゴリーに分けられます。

1)EUの製品安全法に該当する製品に使用されるAIシステム。これには、玩具、航空、自動車、医療機器、リフトなどが含まれます。

2)EUのデータベースに登録する必要がある特定の分野に分類されるAIシステム:

- 重要インフラの管理と運用

- 教育と職業訓練

- 雇用、労働者管理、自営業へのアクセス

- 不可欠な民間サービスと公共サービス及び便益へのアクセスと享受

- 法執行

- 移民、亡命、国境管理

- 法の解釈と適用における支援

リスクの高いすべてのAIシステムは、市場に投入される前、または、そのライフサイクルを通じて評価されます。人々は、指定された国家当局にAIシステムに関する苦情を申し立てる権利を持つことになります。

透明性の要件

ChatGPTのような生成AIは、ハイリスクに分類されませんが、透明性の要件とEU著作権法に準拠する必要があります。

- コンテンツがAIによって生成されたことを開示すること

- 違法なコンテンツを生成しないようにモデルを設計すること

- AIのトレーニングに使用した、著作権保護されたデータの概要を公開すること

より高度なAIモデルである「GPT-4」のように、システミックリスクをもたらす可能性のある影響の大きい汎用AIモデルは、徹底的な評価を受けなければならず、重大なインシデントが発生した場合は欧州委員会に報告する必要があります。

AIを使用して生成または変更されたコンテンツ(画像、音声、ディープフェイクなどの動画ファイル)は、AIによって生成されたものであることを明確に表示し、ユーザーがそのようなコンテンツに遭遇したときに認識できるようにする必要があります。

イノベーションのサポート

この法律は、スタートアップ企業や中小企業に対して、一般公開前にAIモデルを開発および訓練する機会を提供することを目的としています。

そのため、国家当局は、現実世界に近い条件をシミュレートするテスト環境を企業に提供する必要があります。

次のステップ

欧州議会は2024年3月にAI規制法を採択し、理事会は2024年5月に承認しました。AI規制法は発効後24か月で完全に適用されますが、一部はそれよりも早く適用されます。

- 容認できないリスクをもたらすAIシステムの禁止は、発効から6ヶ月後に適用される

- 実施規範は施行から9ヶ月後に適用される

- 透明性要件に準拠する必要がある汎用AIシステムに関する規則は、発効から12ヶ月後に適用される

リスクの高いシステムは、それらに関する義務が発効から36ヶ月後に適用されるため、要件に適合するのに、より長い時間の猶予があります。

—(発表文書の和訳はここまで)—

「翻訳で読む各国のAI動向」シリーズでは、引き続き各国のAI最新情報をお届けします。ご自身でもAIの最新動向を追いかけたいという方、AIの国際動向に興味がある方は、みらい翻訳のサービスを利用して海外の記事や公式文書などを翻訳してみてください。